Когда борьба оборачивается против тебя: Facebook закрыл антифрод-группу datingscammer.info и заблокировал её администраторов

Группа существовала на Facebook более шести лет, насчитывала тысячи участников и была посвящена разоблачению мошенничества на сайтах знакомств. Без какого-либо предварительного предупреждения Facebook удалил сообщество и одновременно заблокировал личные профили его администраторов без возможности восстановления. По сути, это означает, что вместо поддержки волонтёрской инициативы по борьбе с мошенничеством платформа фактически предоставила преимущество злоумышленникам, лишив пользователей надёжного источника проверенной информации и предупреждений.

Группа DatingScammer.info была создана с благородной миссией — защищать людей от мошенников, действующих на платформах знакомств.

На протяжении более шести лет сообщество занималось важной социальной работой:

- примеры фейковых профилей на сайтах знакомств и советы по их распознаванию;

- информация о реальных людях, занимающихся мошенничеством (в рамках закона и правил платформы);

- новости и аналитические статьи о различных видах мошенничества на сайтах и в приложениях знакомств.

Постоянными читателями группы были жертвы мошенников, OSINT-волонтёры и пользователи, желающие научиться распознавать подозрительные контакты.

Как это произошло

По словам наших администраторов, группа была удалена внезапно, без каких-либо предварительных предупреждений или «жёлтых карточек». Одновременно с этим личные аккаунты администраторов были заблокированы без права на обжалование и без объяснения причин.

С точки зрения пользователя это выглядит как полное отсутствие прямой коммуникации с технической поддержкой: невозможно открыть полноценное обращение, получить прозрачное разъяснение нарушения или оспорить решение в разумные сроки. (Хотя Meta публично заявляет о наличии внутренних процедур пересмотра модерационных решений, на практике их доступность и эффективность для пользователей остаются непрозрачными.)

Почему это опасно для добросовестных пользователей

Удаление сообщества по борьбе с мошенничеством создаёт информационный вакуум. Мошенники используют социальные платформы как конвейер для массового установления контактов с жертвами: чем меньше существует публичных контрмер и разоблачительных публикаций, тем проще им «сжечь» аккаунт и запустить схему заново.

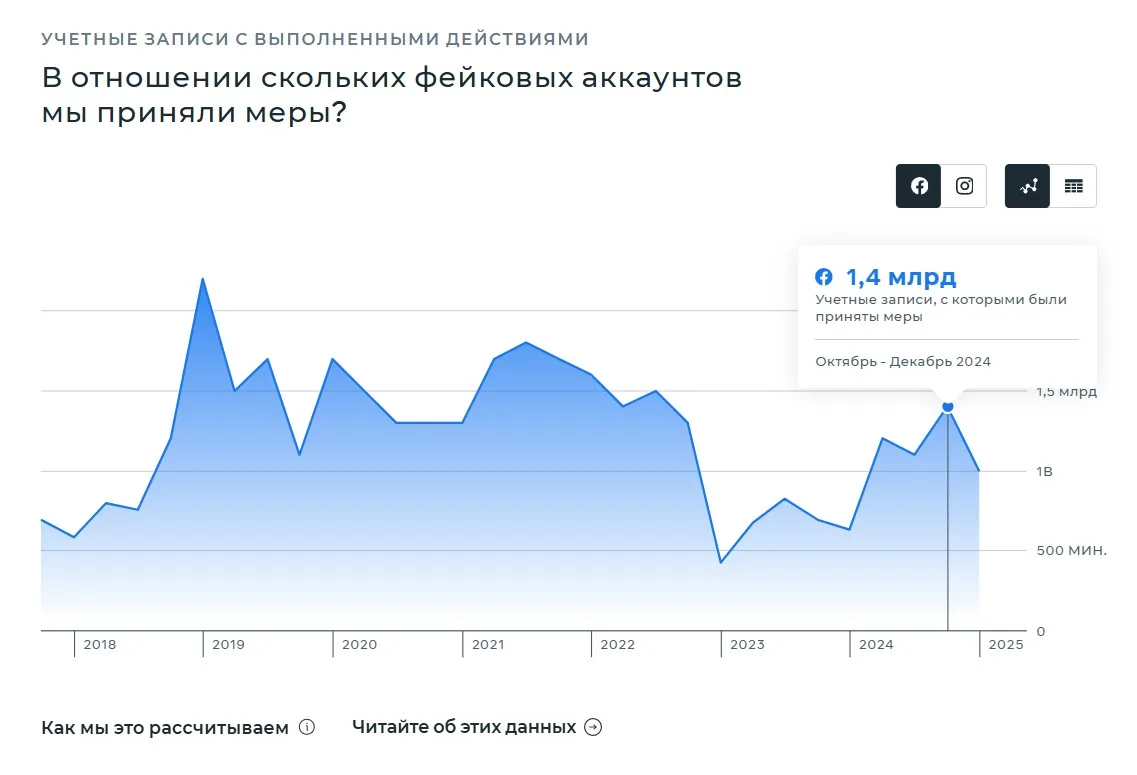

Парадокс заключается в том, что сами отчёты Meta подтверждают колоссальные масштабы проблемы фейковых аккаунтов. Согласно официальному центру прозрачности компании, в первом квартале 2025 года доля поддельных аккаунтов оценивалась примерно в 3% от месячной аудитории Facebook по всему миру. Это означает миллионы активных фейковых профилей, ежедневно взаимодействующих с обычными пользователями.

Исторически компания удаляла от сотен миллионов до миллиардов фейковых аккаунтов каждый квартал. Например, в первом квартале 2019 года Facebook сообщил об удалении 2,2 миллиарда поддельных аккаунтов — рекордном всплеске, связанном с автоматизированными атаками.

Даже вне «пиковых» кварталов цифры остаются колоссальными: в третьем квартале 2023 года Meta сообщила об удалении 827 миллионов фейковых аккаунтов. Годовые показатели достигают многих миллиардов деактивированных регистраций.

Независимые аналитики, агрегирующие данные Meta, оценивают, что с 2017 года общее количество удалённых поддельных аккаунтов исчисляется десятками миллиардов. Конкретные годовые значения варьируются в зависимости от методологии подсчёта, однако масштабы проблемы носят системный и многолетний характер.

Где логика модерации даёт сбой

- Отсутствие прозрачности — пользователи и администраторы не знают, какой пост или действие вызвало санкцию и как исправить ситуацию.

- Нет эффективного канала обратной связи — формальные формы для апелляций часто не предоставляют чёткого статуса рассмотрения или сроков ответа. В результате законные антифрод-инициативы подвергаются более серьёзным рискам, чем серийные мошенники, для которых блокировка аккаунта — лишь «стоимость ведения бизнеса».

- Эффект устрашения — увидев, что произошло с этой группой, другие модераторы по борьбе с мошенничеством могут начать заниматься самоцензурой, снижая объём ценной профилактической информации.

Почему это выглядит как поддержка мошенников

Разрешая бесконечный поток новых фейковых аккаунтов и одновременно закрывая площадки, где пользователи учатся распознавать мошенничество, платформа фактически облегчает работу злоумышленников. Борьба с мошенничеством не может опираться только на массовое автоматическое удаление аккаунтов; необходима полноценная экосистема — публичное образование, целевой анализ случаев и возможность оперативно обжаловать ошибочные решения модерации.

Что платформа могла бы и должна делать

-

Обеспечить прозрачность модерационных решений: предоставлять чёткий идентификатор дела, точное нарушение правил и доступный путь для исправления ситуации.

- Создать ускоренный канал апелляций для антифрод-сообществ и расследований, представляющих общественный интерес.

- Включать в «белый список» доверенные инициативы с высоким уровнем доверия и предоставлять им прямые контакты для поддержки.

- Согласовать политику с отчётами о прозрачности: если официально признаётся существование миллионов фейковых аккаунтов, модерация не должна наказывать тех, кто помогает пользователям их распознавать.

Удаление группы datingscammer.info и блокировка её администраторов без предупреждения является наглядным примером того, как добрые намерения автоматической модерации могут обернуться против пользователей. Когда платформа ежегодно удаляет миллиарды фейковых аккаунтов, но при этом уничтожает независимые источники образования и профилактики, выигрывают не честные пользователи, а те, кто наживается на обмане. Facebook необходимы не только мощные алгоритмы, но и ответственность за принятые решения, прозрачность процедуры апелляций и подлинное партнёрство с теми, кто работает над безопасностью интернета.